RealFormer:把残差转移到Attention矩阵上面去

大家知道 Layer Normalization 是 Transformer 模型的重要组成之一,它的用法有 PostLN 和 PreLN 两种,论文 On Layer Normalization in the Transformer Architecture [1] 中有对两者比较详细的分析。简单来说,就是 PreLN 对梯度下降更加友好,收敛更快,对训练时的超参数如学习率等更加鲁棒等,反正一切都好但就有一点硬伤:PreLN 的性能似乎总略差于 PostLN。

最近 Google 的一篇论文提出了 RealFormer 设计,成功地弥补了这个 Gap,使得模型拥有 PreLN 一样的优化友好性,并且效果比 PostLN 还好,可谓“鱼与熊掌兼得”了。

论文标题:

RealFormer: Transformer Likes Residual Attention

论文链接:

https://arxiv.org/abs/2012.11747

形式

RealFormer 全称为“Residual Attention Layer Transformer”,即“残差式 Attention 层的 Transformer 模型”,顾名思义就是把残差放到了 Attention 里边了。

关于这个名字,还有个小插曲。这篇文章发布的时候,RealFormer 其实叫做Informer,全称为“Residual Attention Transformer”,原论文名为 Informer: Transformer Likes Informed Attention [2] ,显然从 Informer 这个名字我们很难想象它的全称,为此笔者还吐槽了 Google 在起名方面的生硬和任性。

隔了一天之后,发现它改名为 RealFormer 了,遂做了同步。不知道是因为作者大佬看到了笔者的吐槽,还是因为 Informer 这个名字跟再早几天的一篇论文 Informer: Beyond Efficient Transformer for Long Sequence Time-Series Forecasting [3] 重名了,哈哈。

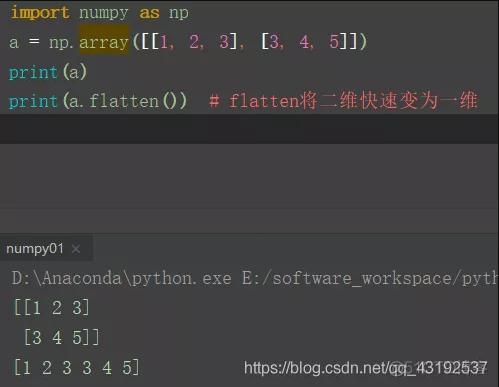

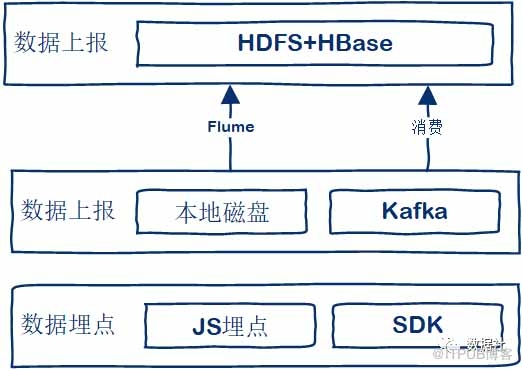

PostLN、PreLN和RealFormer结构示意图

说回模型,如上图所示,RealFormer 主要是把残差放到了 Attention 矩阵上面了,而整体依然保持了 PostLN 的结构,因此既保持了 PostLN 的性能,又融合了残差的友好。具体来说,就是原来第 n 层的 Attention 为:

现在改为了:

而已。全文终。

实验

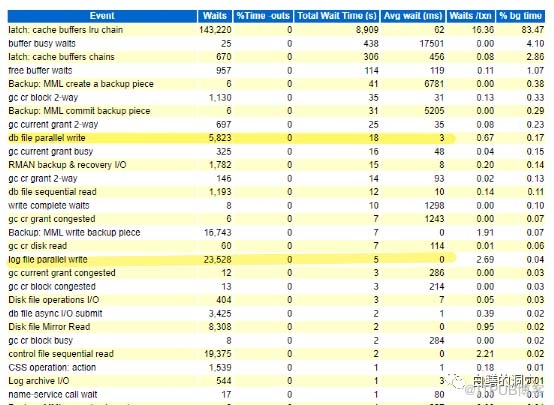

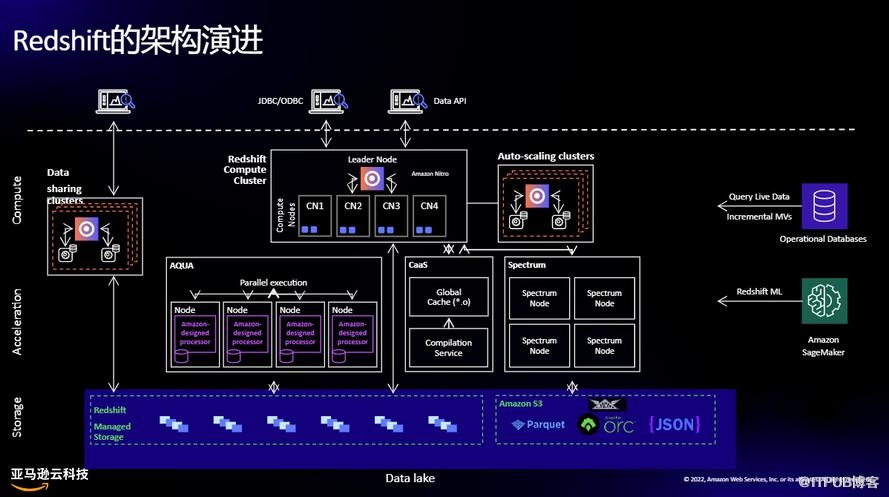

当然,那么快就“全文终”是不可能的,好歹也得做做实验看看效果,但只看改动的话,确实已经终了,就那么简单。原论文做的实验很多,基本上所有的实验结果都显示在效果上:

看来,这次 PostLN 可能真的需要退场了。部分实验结果如下:

MLM准确率对比

SQuAD评测对比

GLUE评测对比

不同训练步数效果对比

值得特别指出的是第一张图和第四张图。从第一张图我们可以看到,对于 RealFormer 结构,加大模型规模(large 到 xlarge)可以带来性能的明显提升,而 ALBERT 论文曾经提到加大 BERT 的模型规模并不能带来明显受益,结合两者说明这可能是 PostLN 的毛病而不是 BERT 的固有毛病,换成 RealFormer 可以改善这一点。

从第四张图我们可以看到,RealFormer 结构训练 50 万步,效果就相当于 PostLN 训练 100 万步,这表明 RealFormer 有着很高的训练效率。

除了上述实验外,论文还对比了不同学习率、不同 Dropout 比例的效果,表明 RealFormer 确实对这些参数是比较鲁棒的。原论文还分析了 RealFormer 的 Attention 值分布,表明 RealFormer 的 Attention 结果更加合理。

分析

这一节我们对 RealFormer 做一个简单的思考分析。

另一方面,Attention 的概率值可能会有趋同的趋势,也就是说 Attention 的模式可能越来越稳定,带来类似 ALBERT 参数共享的正则化效应,这对模型效果来说可能是有利的,直觉上来说,用 RealFormer 结构去做 FastBERT [6] 之类的自适应层数的改进,效果会更好,因为 RealFormer 的 Attention 本身会有趋同趋势,更加符合 FastBERT 设计的出发点。

总结

实验结果表明,RealFormer 同时有着 PostLN 和 PreLN 的优点,甚至比两者更好,是一个值得使用的改进点。

参考文献

[1] https://arxiv.org/abs/2002.04745

[2] https://arxiv.org/abs/2012.11747v1

[3] https://arxiv.org/abs/2012.07436

[4] https://arxiv.org/abs/1801.04406

[5] https://arxiv.org/abs/2003.04887

声明:文章收集于网络,版权归原作者所有,为传播信息而发,如有侵权,请联系小编删除,谢谢!

时间:2021-01-02 20:49 来源: 转发量:次

声明:本站部分作品是由网友自主投稿和发布、编辑整理上传,对此类作品本站仅提供交流平台,转载的目的在于传递更多信息及用于网络分享,并不代表本站赞同其观点和对其真实性负责,不为其版权负责。如果您发现网站上有侵犯您的知识产权的作品,请与我们取得联系,我们会及时修改或删除。

相关文章:

相关推荐:

网友评论:

最新文章

热门文章